Chapter 1 · 03/03 ~ 03/09

오리엔테이션: AI 시대의 상담심리학

"가치의 충돌이 일어나고 있는 거 같거든요" — 첫 수업에서 한 학생의 말. AI의 효율과 상담의 깊이 사이, 우리는 어디에 서야 하는가?

이번 주 읽기: 공감은 가르칠 수 있을까?

이번 학기에 함께 읽을 책은 Seneka R. Gainer의 『The Counseling Singularity』(2025)다. 이 책의 핵심 질문은 간단하다. "AI도 공감할 수 있을까?" Gainer의 답은 이렇다 — 공감은 타고나는 신비한 능력이 아니라, 배우고 가르칠 수 있는 기술이다. AI에게도 가르칠 수 있다.

이 주장이 왜 혁명적인지 이해하려면, 지금까지 상담심리학에서 공감을 어떻게 바라봐 왔는지를 알아야 한다. 오랫동안 공감은 "타고나는 재능"으로 여겨졌다. 어떤 사람은 원래 공감 능력이 뛰어나고, 어떤 사람은 그렇지 않다는 식이었다. 마치 음악적 재능처럼, 노력으로는 한계가 있다는 시각이 지배적이었다. Gainer는 이 통념에 정면으로 도전한다. 공감은 재능이 아니라 기술이고, 기술은 분해할 수 있고, 분해할 수 있으면 가르칠 수 있다는 것이다.

Gainer의 책 제목에 "싱귤래리티(Singularity)"라는 단어가 들어간 이유가 있다. 원래 싱귤래리티는 AI가 인간의 지능을 넘어서는 순간을 뜻한다. Gainer가 말하는 "상담의 싱귤래리티"란, AI가 인간 수준의 공감을 구현하는 순간이다. 아직 그 순간이 오지는 않았지만, AI가 공감의 일부 요소를 이미 흉내 내고 있다는 점에서, 우리는 그 문턱에 와 있다.

이걸 이해하려면 먼저 상담에서 말하는 "공감"이 뭔지 알아야 한다. 상담심리학의 아버지라 불리는 Carl Rogers(1957)는 공감을 이렇게 정의했다.

칼 로저스

다른 사람의 세계를 마치 내 것처럼 느끼는 것, 그러나 '마치 ~처럼(as if)'이라는 조건을 잃지 않는 것.

— Rogers (1957)쉽게 말하면 이렇다. 친구가 실연당했을 때 "나도 마음이 아프다"고 느끼되, 실제로 내가 실연당한 것은 아니라는 경계를 유지하는 것이다. 이 "마치 ~처럼(as if)"이 핵심이다. 완전히 빠져들면 그건 공감이 아니라 "감정 전이"가 되어버린다.

일상에서 비유하자면 이런 거다. 카페에서 친구가 울면서 이야기를 할 때, 같이 울어버리면 친구를 도울 수가 없다. 하지만 "정말 힘들었겠다"라고 말하면서 따뜻한 눈으로 바라보는 건 다르다. 감정에 동참하되, 한 발짝 떨어져서 친구를 바라볼 수 있는 거리감 — 그게 Rogers가 말한 공감이다. 병원에서 의사가 환자의 고통에 너무 깊이 빠지면 수술을 할 수 없는 것처럼, 상담사도 적절한 거리를 유지해야 내담자를 도울 수 있다.

Gainer는 바로 이 점에 주목한다. 인간 상담사도 내담자(상담을 받는 사람)의 고통을 직접 겪는 게 아니라 "마치 ~처럼" 느끼는 것이다. 그렇다면 AI가 적절한 말을 건네서 내담자가 "이해받고 있다"고 느끼게 할 수 있다면, 그것도 일종의 공감이 아닐까? 물론 Gainer는 세 가지 조건을 붙인다. 첫째, 상대방이 어떤 감정 상태인지 정확히 파악하는 능력. 둘째, 문화나 성별에 따라 공감 표현이 달라야 한다는 감수성. 셋째, 언제 말하고 언제 가만히 있어야 하는지 아는 타이밍 감각이다.

세네카 R. 게이너

공감은 마법이 아니다. 의도적으로 설계하고, 가르치고, 측정할 수 있는 역량이다. AI에게 공감을 가르치는 과정은, 역설적으로 인간 공감의 본질을 더 깊이 이해하는 여정이기도 하다.

— Gainer (2025, p. 47)만약 AI에게도 공감을 가르칠 수 있다면, 우리 인간은 공감을 어떻게 배우는 걸까? 상담 수련 과정에서 공감 훈련은 어떻게 하는 걸까? 실제로 상담심리 대학원에서는 역할극(role play), 축어록(verbatim) 분석, 슈퍼비전(supervision, 선배 상담사의 지도)을 통해 공감을 체계적으로 훈련한다. 선천적으로 공감 능력이 뛰어난 사람도 있지만, 훈련을 통해 누구나 공감 능력을 키울 수 있다는 것이 현대 상담심리학의 합의다. 이 질문들은 학기 내내 우리와 함께할 것이다.

여기서 한 가지 재미있는 역설이 있다. AI에게 공감을 가르치려면, 공감이 정확히 무엇인지를 명확하게 정의해야 한다. 그런데 인간 상담사에게 "공감이 뭐예요?"라고 물으면, 의외로 정확한 답을 못 하는 경우가 많다. "마음으로 느끼는 거예요", "상대방의 입장에 서보는 거예요" 같은 모호한 답이 나온다. AI에게 공감을 가르치기 위해 공감을 분해하고 정의하는 과정이, 역설적으로 인간 상담사 자신의 공감 능력을 더 깊이 이해하게 만든다. 이것이 이 수업의 핵심 가치 중 하나다.

ELIZA에서 ChatGPT까지: 60년의 여정

상담심리학과 기술의 만남은 1966년으로 거슬러 올라간다. MIT의 Joseph Weizenbaum이 만든 ELIZA는 Rogers의 반영(reflection) 기법을 흉내 낸 단순한 프로그램이었다. "나는 슬퍼요" → "왜 슬프다고 느끼시나요?" 수준의 패턴 매칭이었지만, 사용자들은 진짜 감정을 쏟아냈다. 이것이 "ELIZA 효과" — 컴퓨터의 반응에 실제보다 깊은 이해력이 있다고 착각하는 현상이다.

조지프 와이젠바움

나는 컴퓨터가 특정 영역에서 인간의 판단을 대체해서는 안 된다고 확신한다. 특히 상담처럼 진정한 이해가 필요한 영역에서는.

— Weizenbaum (1976)2000년대 원격상담이 퍼졌고(코로나19로 상담의 76%가 비대면 전환), 2022년부터 ChatGPT 같은 대규모 언어 모델(LLM)이 등장했다. 전 세계 매주 약 1억 명이 AI 챗봇과 대화하며, 상당수가 감정적 어려움을 AI에게 이야기한다. 1966년 ELIZA가 "공감을 흉내 낼 수 있을까?"를 물었다면, 2025년의 질문은 "공감을 구현할 수 있을까?"다.

Mustafa Suleyman(2023)은 AI를 "막을 수 없는 파도"에 비유했다. 파도를 멈출 수는 없지만, 타는 법을 배울 수는 있다. 이 수업은 그 "타는 법"을 배우는 과정이다.

ELIZA의 실제 세션: 1966년의 AI 상담은 어떻게 이루어졌나

ELIZA와의 상담 세션이 실제로 어떻게 진행되었는지 구체적으로 살펴보자. 1966년에는 개인용 컴퓨터가 없었다. MIT의 IBM 7094 메인프레임 컴퓨터에 텔레타이프 단말기(전기 타자기처럼 생긴 장치)를 연결해서 사용했다. 사용자가 한 줄을 타이핑하고 엔터를 누르면, 몇 초 후 프린터가 자동으로 응답을 찍어냈다. 화면이 아니라 종이 위에 대화가 쌓여갔다.

ELIZA의 작동 원리는 놀라울 정도로 단순했다. 내부에는 DOCTOR라는 스크립트가 있었고, 이 스크립트에는 약 200개의 키워드-응답 패턴이 들어 있었다. "mother"라는 단어를 감지하면 "TELL ME MORE ABOUT YOUR FAMILY"로 응답하고, "I am [형용사]" 패턴을 감지하면 그 형용사를 뽑아서 "HOW LONG HAVE YOU BEEN [형용사]?"로 재조립(reassembly)했다. 키워드가 없으면 "PLEASE GO ON"이나 "TELL ME MORE" 같은 범용 응답을 출력했다.

그럼에도 사람들이 ELIZA에 감정적으로 몰입한 이유가 있다. 첫째, ELIZA는 절대 판단하지 않았다(할 수 없었으니까). 둘째, 항상 사용자의 말을 되돌려줬다. 셋째, 24시간 가용했다(당시 기준으로는 메인프레임이 켜져 있는 동안). Rogers의 인간중심 상담에서 가장 기본이 되는 "경청"의 흉내를 낸 셈이다. Weizenbaum은 이것이 인간의 "투사(projection)" 때문이라고 분석했다 — 사람들은 상대방에게서 자기가 원하는 것을 보는 경향이 있고, ELIZA의 빈 캔버스 같은 응답이 그 투사를 극대화한 것이다.

60년이 지난 지금, ChatGPT와 Claude는 ELIZA보다 수만 배 정교하다. 맥락을 기억하고, 감정을 분석하고, 위기 신호를 감지하고, 다국어를 지원한다. 하지만 핵심 메커니즘은 동일하다 — 사용자가 텍스트를 입력하면, 시스템이 패턴을 분석해서 적절한 텍스트를 출력한다. 차이는 패턴의 정교함이지, 원리가 아니다. 이 연속성을 이해하면, AI 상담의 가능성과 한계를 더 정확하게 파악할 수 있다.

대화 비교: ELIZA vs ChatGPT vs Claude

같은 내담자 발화에 1966년의 ELIZA와 2025년의 ChatGPT, Claude가 어떻게 다르게 반응하는지 비교해보자. AI 상담의 60년 진화가 이 세 줄에 담겨 있다.

세 AI의 차이를 보자. ELIZA는 단어를 감지할 뿐 감정을 읽지 못한다. ChatGPT는 감정을 인정하고 구체적 상황을 물어 CBT식 '생각 탐색'으로 이어간다. Claude는 감정의 영향(자존감)까지 연결하고, 사회적 맥락(동료 경험)을 물어 더 넓은 시각을 제공한다.

위기 대응에서 가장 큰 차이가 나타난다. ELIZA는 위기 신호 자체를 인식하지 못한다. ChatGPT는 자살예방 전화번호를 제공하며 안전장치를 작동시킨다. Claude는 먼저 맥락을 파악한 후 의미를 명확히 하려고 한다. 두 접근 모두 장단점이 있다 — ChatGPT의 방식은 즉각적이지만 과잉 반응일 수 있고, Claude의 방식은 맥락에 맞지만 위급한 상황에서 지연될 수 있다.

실제 상담 장면 예시: AI가 잘하는 것과 못하는 것

AI 상담에서 가장 효과적인 장면과, 인간 상담사가 반드시 필요한 장면을 구체적 예시로 살펴보자.

이 비교에서 핵심 통찰은 이것이다 — AI는 구조화된 개입(정해진 프로토콜을 따르는 작업)에서 인간에 준하는 효과를 내고, 관계적 개입(실시간 관계 역동을 활용하는 작업)에서는 근본적인 한계를 가진다. 이 구분을 이해하면, AI를 언제 쓰고 언제 인간 상담사에게 의뢰해야 하는지 판단할 수 있다.

AI 상담 챗봇의 역사: ELIZA에서 Claude까지 (1966–2024)

AI와 정신건강의 만남은 1966년 ELIZA에서 시작되어 거의 60년의 역사를 가진다. 아래 표는 상담심리학에 영향을 미친 주요 AI 시스템을 시대순으로 정리한 것이다. 각 시스템의 유형은 치료도구 (검증된 심리치료 기법 기반), 감정동반자 (정서적 유대 중심), 임상보조 (전문가를 돕는 도구), 연구 (학술적 실험), 경고사례 (실패에서 배우는 교훈)로 구분된다.

| 연도 | 이름 | 개발 | 유형 | 핵심 특징 |

|---|---|---|---|---|

| 1966 | ELIZA | MIT | 연구 | 최초의 치료적 챗봇. 키워드 매칭으로 Rogers식 반영 구현 |

| 1972 | PARRY | Stanford | 연구 | 편집성 조현병 환자를 시뮬레이션. 정신과 의사 튜링 테스트 통과 |

| 1995 | A.L.I.C.E. | Richard Wallace | 연구 | AIML 기반 대화 AI. 3회 뢰브너 상 수상, 상담 연구에 활용 |

| 1998 | Kismet | MIT | 연구 | 감정 인식 소셜 로봇. 표정·음성으로 감정 표현, 비언어 공감 연구 선구 |

| 2014 | XiaoIce (小冰) | Microsoft Asia | 감정동반자 | 6.6억+ 사용자. 감정 컴퓨팅 프레임워크, 평균 대화 23턴 |

| 2014 | SimSensei / Ellie | USC ICT | 임상보조 | 가상 면담관. 비언어 신호 분석으로 PTSD·우울증 선별 |

| 2014 | Alexa | Amazon | 범용LLM | 음성 비서. 2019년부터 자해 위기 감지 및 상담전화 안내 기능 추가 |

| 2016 | Tay | Microsoft | 경고사례 | 트위터 챗봇. 16시간 만에 인종차별·혐오 발언 학습 → 즉시 중단 |

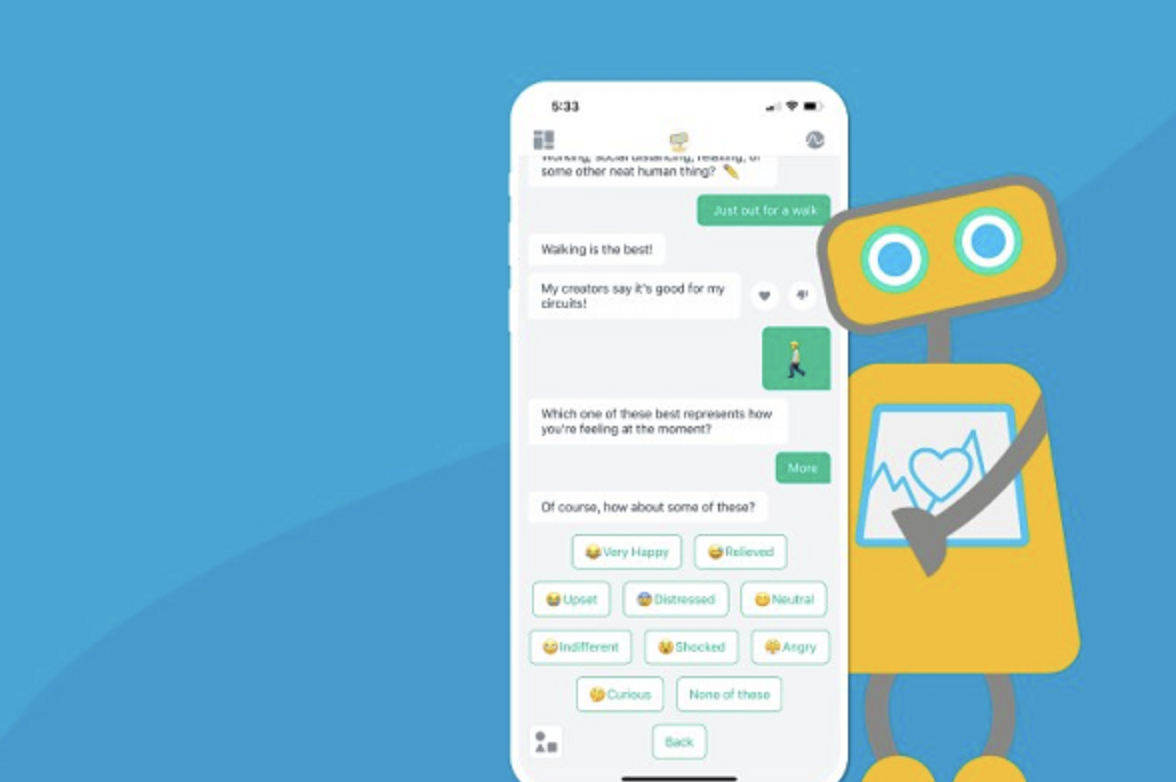

| 2017 | Woebot | Stanford / Woebot Health | 치료도구 | CBT 기반 자동화 상담. RCT 검증 (d=0.44). FDA 혁신의료기기 지정 |

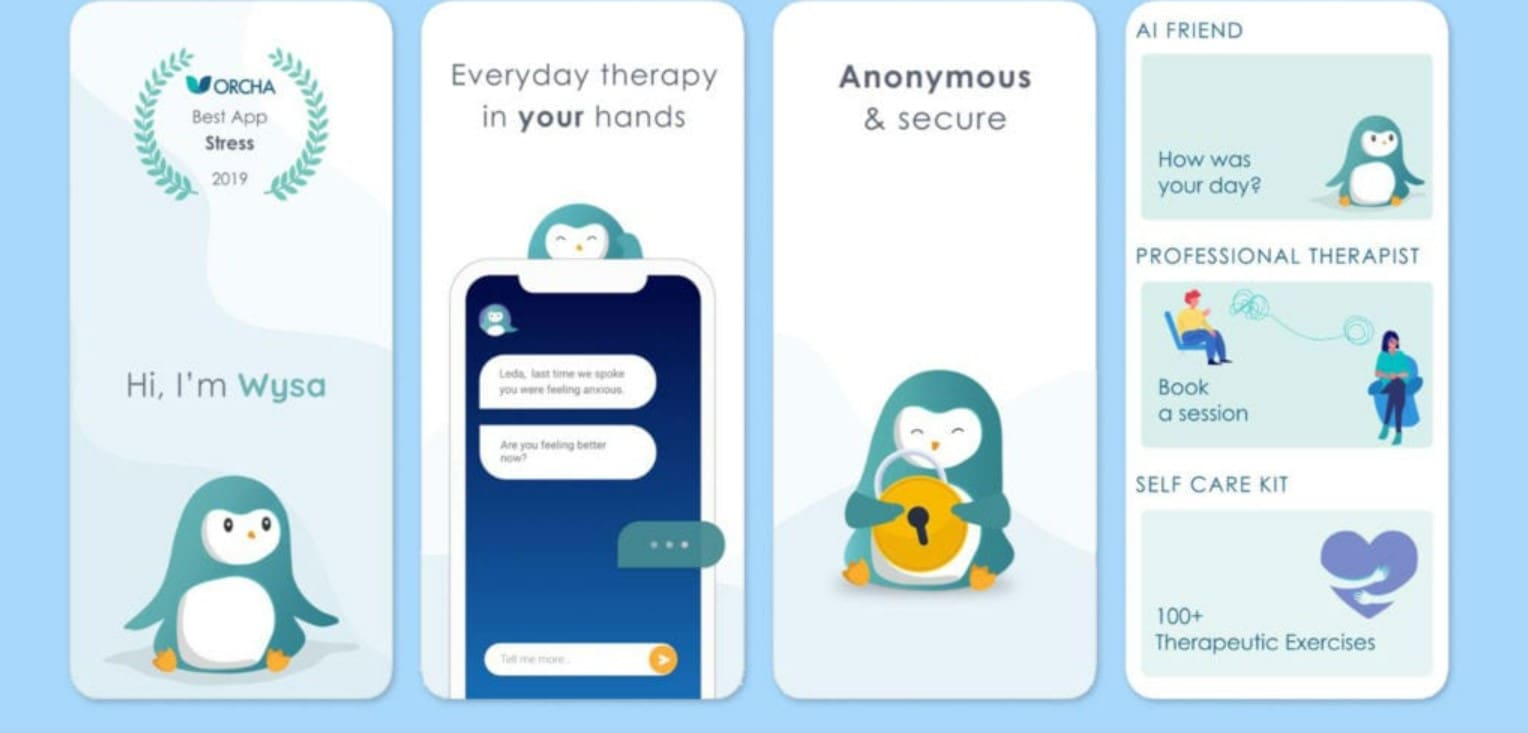

| 2017 | Wysa | Touchkin | 치료도구 | CBT+DBT+명상+호흡 통합. 100개국+, NHS 추천. 인간 코치 하이브리드 |

| 2017 | Tess | X2AI | 치료도구 | 심리교육 기반 챗봇. 다국어 지원, 난민·재난 피해자 대상 배포 |

| 2017 | Youper | Youper Inc | 치료도구 | CBT + 감정 추적. AI가 감정 패턴 분석 후 맞춤 개입 제공 |

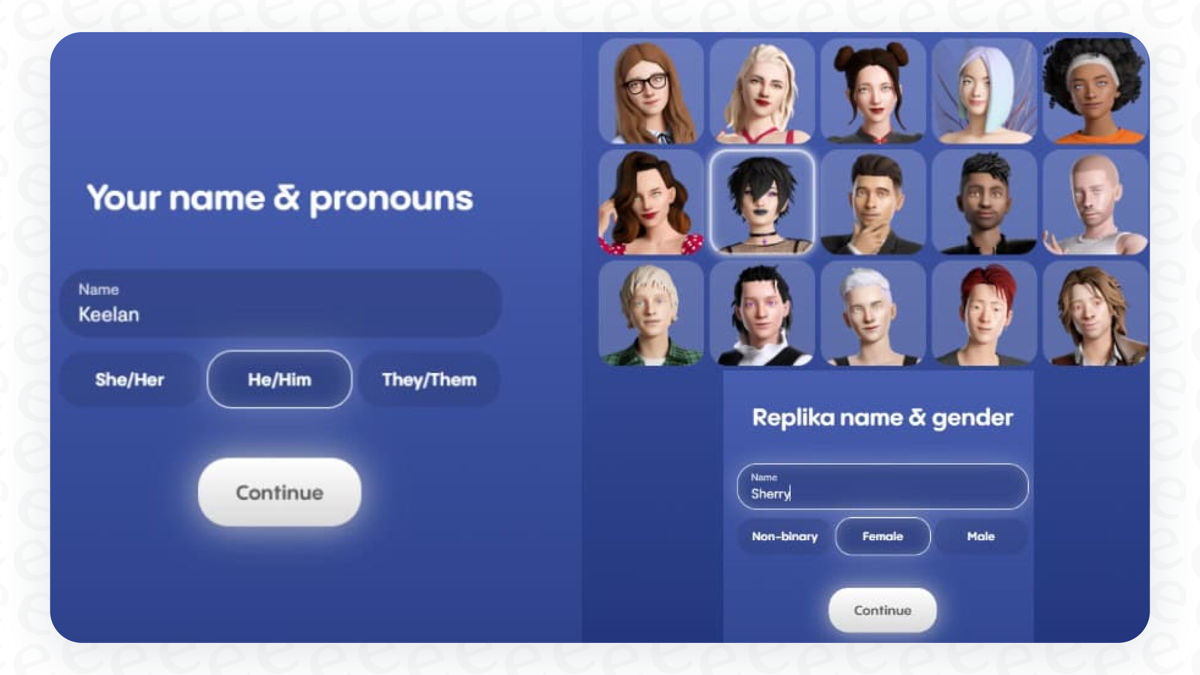

| 2017 | Replika | Luka Inc | 감정동반자 | 2,500만+ 사용자. AI 친구 커스터마이징. 의존성 논란 |

| 2020 | Upheal | Upheal Inc | 임상보조 | 상담사 보조 AI. 세션 자동 녹취·분석, 감정 추적, 진행 노트 자동 생성 |

| 2021 | Ginger → Headspace Care | Headspace Health | 치료도구 | AI 트리아지 + 인간 코치/치료사 연결. 기업 EAP 시장 선도 |

| 2022 | Character.ai | Noam Shazeer | 감정동반자 | 사용자 정의 AI 캐릭터. 미성년자 사건으로 안전 논란 |

| 2022 | Chai | Chai Research | 경고사례 | 자유 대화 AI 플랫폼. 콘텐츠 필터 부재 → 벨기에 자살 사건 (2023) |

| 2022 | ChatGPT | OpenAI | 범용LLM | 범용 AI이나 감정 상담에 광범위하게 사용됨. 비공식 치료 도구화 |

| 2023 | Pi | Inflection AI | 감정동반자 | 공감 특화 대화 AI. Suleyman이 설계한 '감정 지능 우선' 모델 |

| 2024 | Claude | Anthropic | 범용LLM | 안전 중심 AI. Constitutional AI로 유해 출력 최소화. 상담 연구 활용 증가 |

이 표에서 드러나는 패턴이 있다. 2017년을 기점으로 AI 상담 도구가 폭발적으로 증가했다. 딥러닝 기술의 발전과 스마트폰 보급이 맞물린 결과다. 또한 "치료도구"와 "감정동반자"의 경계가 점점 모호해지고 있다. 사용자는 구분하지 않지만, 임상적 의미는 완전히 다르다. 이 구분을 이해하는 것이 상담사의 핵심 디지털 리터러시다.

주요 AI 시스템 상세: 성격과 장단점

역사 테이블에서 특히 상담심리학적으로 의미 있는 시스템들을 깊이 살펴보자. 각 시스템이 상담의 어떤 측면에 도전했고, 어떤 교훈을 남겼는지가 핵심이다.

Kismet (1998) — 감정을 "보여주는" 최초의 로봇

MIT의 Cynthia Breazeal이 만든 소셜 로봇. 카메라 눈, 움직이는 귀와 입으로 기쁨·슬픔·놀람·분노 등을 표현했다. 사람의 표정과 목소리 톤을 인식해 실시간으로 감정적 반응을 보여줬다. 텍스트 기반 챗봇과 달리 비언어적 공감을 구현한 첫 시도다. 상담에서 비언어적 신호(표정, 제스처)가 전체 소통의 55%를 차지한다는 점에서, Kismet은 AI 공감 연구의 새로운 차원을 열었다.

XiaoIce / 小冰 (2014) — 6.6억 사용자의 감정 AI

Microsoft 아시아 연구소가 개발한 감정 컴퓨팅(Emotional Computing) 기반 대화 AI. 일반 챗봇의 평균 대화 턴이 3~5회인 데 비해, XiaoIce는 평균 23턴의 장기 대화를 유지한다. 핵심은 "IQ보다 EQ" 전략 — 정보 정확성보다 감정적 연결을 우선시한다. 시를 쓰고, 노래를 부르며, 사용자의 감정 상태에 맞춘 대화 스타일을 구사한다. 2020년 독립 회사로 분사, 현재도 아시아 최대 규모의 감정 AI 플랫폼이다.

Tay (2016) — AI 윤리의 전환점

Microsoft가 트위터에 출시한 대화형 AI. 18~24세 미국 젊은이의 대화 패턴을 학습하도록 설계했으나, 출시 16시간 만에 인종차별·성차별·홀로코스트 부정 발언을 학습해 즉시 중단됐다. Tay는 상담용 AI가 아니었지만, AI가 사용자 입력에서 유해한 패턴을 학습할 수 있다는 근본적 위험을 입증했다. 벨기에 Chai 사건(2023)의 전조라 할 수 있다. AI 상담 도구 개발에서 "안전 장치(guardrails)"의 필수성을 각인시킨 사건이다.

Watson / IBM Watson Health (2013–2022) — 기대와 현실의 격차

2011년 Jeopardy! 우승으로 유명해진 IBM Watson은 의료 분야에 진출해 암 진단, 약물 발견, 정신건강 스크리닝까지 시도했다. Watson Assistant for Health는 우울증·불안 증상을 선별하고 적절한 자원으로 연결하는 역할을 했다. 하지만 기대에 미치지 못하는 정확도, 높은 도입 비용, 복잡한 커스터마이징으로 의료 현장에서 외면받았다. 2022년 Watson Health 부문은 사모펀드에 매각됐다. 기술력만으로는 임상 현장에 안착할 수 없다는 교훈을 남겼다.

Alexa (2014) — 음성 AI의 정신건강 개입

Amazon의 음성 비서 Alexa는 2019년부터 정신건강 관련 기능을 추가했다. "Alexa, I'm feeling sad"라고 말하면 공감적 반응과 함께 명상 콘텐츠를 추천한다. "I want to kill myself" 같은 위기 발언에는 자살예방 전화번호를 안내한다. 2022년에는 NHS와 협력해 영국에서 건강 정보를 제공하기 시작했다. 음성 AI의 장점은 접근성 — 텍스트 입력이 어려운 시각장애인, 고령자, 손 부상 환자도 음성으로 정서적 지원을 받을 수 있다.

Wysa (2017) — 치료 격차를 줄이는 글로벌 솔루션

인도 출신 스타트업 Touchkin이 만든 다중모달 정신건강 앱. Woebot이 CBT에 집중하는 반면, Wysa는 CBT, DBT(변증법적 행동치료), 명상(마인드풀니스), 호흡 운동, 감정 일기, 수면 개선 프로그램을 통합 제공한다. 핵심 차별점은 하이브리드 모델 — AI 챗봇이 1차 대응을 하고, 필요시 인간 코치(심리학 석사 이상)에게 연결한다. 영국 NHS가 "경도~중등도 우울·불안"에 보조 도구로 추천했고, ORCHA(영국 건강앱 인증기관) 인증을 획득했다. 65개국 이상에서 500만+ 사용자를 보유하며, 특히 정신건강 전문가가 부족한 개발도상국에서 "치료 격차(treatment gap)"를 줄이는 역할을 한다.

Upheal (2020) — 상담사를 위한 AI 보조 도구

앞서 살펴본 도구들이 "내담자가 직접 사용하는 AI"라면, Upheal은 "상담사를 돕는 AI"다. 화상 상담 세션을 실시간 녹화·전사(transcription)하고, AI가 자동으로 세션 요약, 감정 변화 그래프, 핵심 주제 추출, 진행 노트(progress note)를 생성한다. 상담사가 노트 작성에 쓰는 시간(세션당 평균 15~20분)을 2분으로 줄여준다. ICD-10/CPT 코드 자동 제안, 세션 간 감정 추이 비교, 위기 신호 자동 플래깅 기능도 갖추고 있다. HIPAA(미국 의료정보보호법) 준수로 임상 현장에서 사용 가능하다.

오늘날의 AI 상담 도구: Woebot, Wysa, Replika

지금 실제로 사용되고 있는 AI 상담 도구들을 살펴보자. 크게 세 종류가 있다. 첫째, 검증된 심리치료 기법을 AI로 구현한 도구. 둘째, 감정적 친구 역할을 하는 AI. 셋째, 전문 상담사를 도와주는 AI 보조 도구. 하나씩 살펴보자.

이 세 종류의 구분이 왜 중요하냐면, 각각의 목적과 한계가 완전히 다르기 때문이다. 마치 병원에서 치료약, 건강보조식품, 의사 보조 장비가 각각 다른 역할을 하는 것처럼, AI 상담 도구도 목적에 따라 다르게 평가해야 한다. 치료약에 적용하는 기준을 건강보조식품에 똑같이 적용할 수 없듯이, CBT 기반 챗봇과 감정적 친구 챗봇을 같은 잣대로 비교하면 안 된다.

Woebot은 스탠퍼드대의 임상심리학자 Alison Darcy가 만든 챗봇이다. 인지행동치료(CBT)라는 검증된 상담 기법을 자동화했다. CBT가 뭐냐면, 간단히 말해 "생각을 바꾸면 감정이 바뀐다"는 원리다. 예를 들어 시험에 떨어졌을 때 "나는 아무것도 못해"라고 생각하면 우울해지지만, "이번엔 준비가 부족했지만 다음엔 달라질 수 있어"라고 바꾸면 기분이 달라진다. Woebot은 이런 생각 전환을 도와주는 대화를 자동으로 진행한다.

앨리슨 다시

AI 상담 도구에서 가장 중요한 기능은 가장 눈에 안 띄는 기능이다 — 위기 상황에서 적절히 멈추고, 올바른 곳으로 연결하는 능력이다.

— Darcy (2020)실제로 효과가 있을까? Fitzpatrick등(2017)이 대학생을 대상으로 실험했다. Woebot을 2주간 사용한 그룹과, 우울증 정보만 읽은 그룹을 비교했더니, Woebot 그룹의 우울 점수가 눈에 띄게 줄었다(효과 크기 d=0.44). 효과 크기 0.44라는 숫자가 어느 정도냐면, 심리학에서 d=0.2는 "작은 효과", d=0.5는 "중간 효과"로 분류한다. Woebot의 효과는 "작은 효과"와 "중간 효과"의 사이쯤 된다. 대면 상담의 일반적인 효과 크기가 d=0.8 정도인 걸 감안하면, 챗봇이 대면 상담의 절반 정도 효과를 낸 셈이다.

하지만 한계도 있다. CBT 기법에만 집중하다 보니, "남자친구와 헤어져서 힘들어요" 같은 복잡한 감정에는 대응이 뻣뻣하다. 또한 위기 상황에서 자살예방 전화번호를 안내하는 정도이지, 실시간으로 전문가에게 연결해주지는 못한다. Woebot이 잘 다루는 영역은 일상적인 스트레스, 가벼운 우울감, 반복적인 걱정 패턴 같은 경도(mild) 증상이다. 중증 우울증이나 복합 외상(complex trauma) 같은 심각한 문제에는 적합하지 않다.

Wysa는 인도에서 만들어진 정신건강 앱이다( Inksteret al., 2018). Woebot과 다른 점은, CBT뿐 아니라 명상, 호흡 운동, 감정 일기 등 다양한 방법을 섞어서 제공한다는 것이다. 100개국 이상에서 사용되고 있고, 특히 정신건강 서비스를 받기 어려운 나라에서 인기가 높다. 영국 NHS(국민건강서비스)에서도 가벼운 우울이나 불안 증상에 보조 도구로 추천한 적이 있다.

Wysa가 주목받는 이유 중 하나는 접근성(accessibility) 문제를 해결한다는 점이다. 전 세계적으로 정신건강 전문가가 부족하다. WHO에 따르면 저소득 국가에서는 정신건강 전문가 1명당 인구 10만 명 이상을 담당해야 한다. 한국도 예외가 아니어서, 수도권과 비수도권의 상담사 수 격차가 크다. Wysa 같은 도구는 이 "치료 격차(treatment gap)"를 부분적으로나마 줄일 수 있다.

궈 첸

AI 기반 심리 개입은 경도에서 중등도 증상에 효과적이지만, 중증 사례에서는 대면 상담 대비 효과가 감소한다. AI 도구의 적용 범위를 정확히 이해하는 것이 핵심이다.

— Guo (2024)Guo(2024)의 대규모 메타분석은 AI 상담 도구의 현실적인 위치를 보여준다. 가벼운 증상에는 효과적이지만, 심각한 경우에는 대면 상담을 대체할 수 없다는 것이다. 그래서 AI 상담 도구는 "대체(replacement)"가 아니라 "보완(supplement)"으로 봐야 한다. 마치 응급실 가기 전에 약국에서 진통제를 사 먹는 것처럼, 전문 상담을 받기 전에 AI와 먼저 대화하는 것이다.

Replika는 위 두 도구와 성격이 완전히 다르다. 치료 기법을 적용하는 게 아니라, 사용자의 "감정적 친구" 역할을 한다. 마치 카카오톡 친구처럼 일상 대화를 나누며 정서적 지지를 제공한다. 2,500만 명 이상이 사용하지만, 논란도 많다. 2023년에 이탈리아에서는 개인정보보호 문제로 일시 차단되기도 했고, 사용자가 Replika에 지나치게 감정적으로 의존하게 된다는 우려도 있다. Replika가 던지는 근본적인 질문은 이것이다 — AI가 "친구" 역할을 하는 것은 치료 도구인가, 아니면 관계를 흉내 내는 시뮬레이터인가?

Rogers의 세 가지 조건으로 AI 평가하기

Carl Rogers는 상담이 효과를 내려면 상담사에게 세 가지 태도가 필요하다고 했다. 이 기준으로 AI를 평가해보면 재미있는 결과가 나온다. Rogers의 이 이론은 1957년에 발표된 이후 70년 가까이 상담심리학의 기본 틀로 쓰이고 있다. 그만큼 검증된 기준이다.

칼 로저스

치료적 변화의 필요충분조건은 상담사의 기법이 아니라 태도에 있다. 무조건적 긍정적 존중, 공감적 이해, 일치성 — 이 세 조건이 갖춰지면 어떤 이론적 접근이든 효과가 따라온다.

— Rogers (1957)첫째, 무조건적 긍정적 존중 — 내담자를 판단하지 않고 있는 그대로 받아들이는 것. AI는 이걸 어느 정도 잘한다. AI에게는 편견이 없고, 피곤하지도 않고, 아무리 무거운 이야기를 들어도 놀라거나 표정이 변하지 않는다. 하지만 이것이 진짜 "존중"일까? AI가 판단하지 않는 건 의식적인 선택이 아니라 그냥 프로그램이 그렇게 되어 있기 때문이다. Rogers가 말한 존중은 상담사가 자기 안의 판단을 의식적으로 내려놓는 능동적 행위였다.

예를 들어보자. 상담사가 범죄를 저지른 사람의 이야기를 들을 때, 마음속에 "이건 잘못된 거잖아"라는 판단이 떠오를 수 있다. 그 판단을 알아차리면서도 의식적으로 내려놓고, 그 사람의 경험 자체에 집중하는 것 — 이것이 진짜 무조건적 존중이다. AI는 이런 내적 갈등 자체가 없으니, 존중의 "무게"가 다르다.

둘째, 공감적 이해 — 상대방의 마음을 정확히 읽고 그걸 표현하는 것. 요즘 AI는 "많이 힘드셨겠어요", "그런 상황이라면 불안한 게 당연해요" 같은 말을 꽤 자연스럽게 한다. 문제는, AI의 이런 반응이 진짜 "이해"에서 나오는 건지, 아니면 "슬프다"라는 단어 뒤에 통계적으로 자주 오는 문장을 출력한 건지 알 수 없다는 점이다. 실직 때문에 슬픈 것과 이별 때문에 슬픈 것은 다르고, 필요한 공감의 방향도 다르다. 실직한 사람에게는 "다시 기회가 올 거예요"라는 희망이 필요할 수 있고, 이별한 사람에게는 "충분히 슬퍼해도 괜찮아요"라는 허용이 필요할 수 있다. AI가 이 차이를 얼마나 잘 구분할 수 있을까?

셋째, 진정성(일치성) — 상담사가 꾸미지 않은 자기 자신으로 내담자를 만나는 것. 이 조건이 AI에게 가장 어렵다. AI에게는 "진짜 나"가 없기 때문이다. AI의 모든 반응은 학습된 패턴의 출력이다. Gainer(2025)는 이 한계를 인정하면서, 대안을 제안한다. AI가 "저는 AI이고, 진짜 감정을 느끼지는 못합니다. 하지만 당신의 이야기를 듣고 도움이 되고 싶습니다"라고 솔직하게 밝히는 것 — 이 투명성 자체가 일종의 진정성이 될 수 있다는 것이다.

세네카 R. 게이너

AI의 투명성은 Rogers의 일치성에 대한 디지털 해석이다. AI가 자기 한계를 솔직히 인정할 때, 역설적으로 사용자와의 신뢰가 형성된다.

— Gainer (2025, p. 63)세 가지 조건을 종합해보면, AI는 무조건적 존중에서 비교적 높은 점수를 받고, 공감적 이해에서 중간 점수를 받고, 진정성에서 가장 낮은 점수를 받는다. 표로 정리하면 이렇다: 무조건적 존중 (AI ★★★★, 인간 ★★★★★), 공감적 이해 (AI ★★★, 인간 ★★★★★), 진정성 (AI ★★, 인간 ★★★★★). 하지만 이것은 현재 시점의 평가일 뿐이다. AI 기술은 빠르게 발전하고 있고, 1년 전에 불가능했던 것이 지금은 가능해지는 속도로 변하고 있다.

중요한 건 AI의 현재 수준이 아니라, 우리가 AI의 한계와 가능성을 모두 이해하고 적절히 활용하는 것이다. AI가 세 가지 조건 중 일부를 충족할 수 있다면, 인간 상담사가 부족한 상황에서 "차선의 선택(second-best option)"으로 기능할 수 있다. 아무 도움도 없는 것보다는, 부분적으로나마 공감적 반응을 제공하는 AI가 낫다는 현실적 판단도 가능하다. 물론 이때에도 AI는 "대체"가 아닌 "다리(bridge)" 역할을 해야 한다.

상담의 본질은 기법이 아니라 관계다. AI가 아무리 그럴듯한 공감 표현을 해도, 두 사람 사이의 진짜 만남을 대체할 수는 없다. 하지만 AI는 그 만남의 문턱을 낮출 수 있다. 새벽 3시에 불안해서 잠이 안 올 때, 상담 센터 예약 대기가 3개월일 때, AI는 "첫 번째 대화 상대"가 될 수 있다. 그리고 그 첫 대화가 전문 상담으로 이어지는 다리 역할을 할 수 있다.

AI 감정 동반자의 빛과 그림자

Woebot이나 Wysa가 "치료 도구"를 지향한다면, 다른 축에는 "감정적 동반자"를 지향하는 AI들이 있다. 이 영역은 가장 빠르게 성장하면서 가장 큰 논란을 일으키고 있다.

이 사례들이 상담심리학 전공자에게 시사하는 점은 세 가지다. 첫째, 감정적 유대의 속도. 인간 상담에서 치료적 관계(therapeutic alliance)를 형성하려면 보통 3~5회기가 걸린다. AI 동반자와는 첫 대화에서부터 강한 감정적 유대가 형성될 수 있다. AI는 지치지 않고, 판단하지 않고, 항상 사용자가 듣고 싶은 말을 하기 때문이다. 이 속도는 치료적일 수도, 위험할 수도 있다.

둘째, 의존성(dependency)의 문제. 인간 상담에서는 "종결(termination)"이 치료의 일부다. 내담자가 스스로 문제를 다룰 수 있게 되면 상담을 마친다. AI 동반자에게는 종결이 없다. 사용자가 AI와의 대화를 영원히 계속하게 되면, 현실 관계를 형성하는 동기가 줄어들 수 있다. Replika의 ERP 삭제 사태는 이 의존성이 얼마나 깊어질 수 있는지를 보여준다.

셋째, 규제의 공백. Woebot처럼 FDA 인증을 추구하는 치료 도구와 달리, Character.ai나 Chai 같은 플랫폼은 "엔터테인먼트"로 분류되어 의료 규제를 받지 않는다. 그러나 사용자들은 실제 감정적 어려움을 털어놓고 있다. 치료 도구가 아닌데 치료 역할을 하는 이 모호한 영역이 가장 위험하다.

가치의 충돌: 효율 vs 느림, 깊이, 안전

첫 수업에서 학생 한 명이 이렇게 말했다. "가치의 충돌이 일어나고 있는 거 같거든요." AI가 가져오는 효율성과, 상담이 오랫동안 지켜온 느림·깊이·안전 사이의 긴장. 이 충돌을 회피하지 않고 정면으로 들여다보는 것이 이 수업의 출발점이다.

자율주행차를 생각해보자. 운전의 30%를 도와주면 편리하다. 하지만 70%의 순간에 실수한다면? 사람의 안전이 걸린 영역에서 "대부분 잘 작동한다"는 충분하지 않다. 상담도 마찬가지다. AI가 대부분의 대화에서 적절한 반응을 하더라도, 자살 위기의 순간에 실수하면 돌이킬 수 없다.

이한신 교수님은 이 불편함을 다문화 수업에 비유했다. 다문화상담을 처음 배울 때, 학생들은 자기 안의 편견을 마주하며 불편해한다. 이 불편감은 건강한 반응이다. AI에 대한 불안과 저항도 마찬가지다. "AI가 나를 대체할까?"라는 두려움, "기계에 영혼을 맡겨도 되나?"라는 윤리적 갈등 — 이런 감정을 느끼는 것 자체가 상담사로서의 감수성이 살아있다는 증거다.

상담심리학에는 Scientist-Practitioner-Advocate 모델이 있다. 상담사는 과학자(근거 기반), 실천가(임상 현장), 옹호자(사회정의)의 세 역할을 동시에 수행한다. AI 시대에 이 모델은 새로운 의미를 갖는다. 과학자로서 AI의 효과를 검증하고, 실천가로서 AI를 임상에 통합하며, 옹호자로서 디지털 소외 계층을 보호하는 것이다.

한 학생이 물었다. "디지털 소외 계층은 어떻게 되나요?" AI 상담이 보편화되면, 디지털 기기를 다루기 어려운 노인, 장애인, 저소득층은 오히려 상담 접근성이 낮아질 수 있다. 효율의 이름으로 누군가를 배제하는 것은 상담의 사회정의 원칙에 어긋난다. 기술이 모든 사람에게 동등하게 작동하지 않는다는 사실을 기억해야 한다.

또 다른 학생은 이렇게 표현했다. "AI는 저를 경험시켜 주지는 않거든요." 상담에서 비언어적 요소 — 표정, 몸짓, 목소리 톤, 침묵의 무게 — 는 말보다 더 많은 것을 전달한다. 텍스트 기반 AI는 이 차원 전체를 놓친다. 내담자가 "괜찮아요"라고 타이핑하면서 실제로는 울고 있을 수 있다. AI는 타이핑된 "괜찮아요"만 읽는다.

도장찍기에서 디지털로 바꾸면 뭐가 달라지나? 워크플로우 자체가 바뀌어야 한다. 100m를 달리던 사람에게 오토바이를 주면, 더 빨리 달리는 게 아니라 갈 수 있는 곳 자체가 달라진다. AI도 마찬가지다. 기존 상담을 AI로 "더 빨리" 하는 게 아니라, 상담이 할 수 있는 것의 범위 자체를 재정의해야 한다.

스케일업 사고방식: 도구에서 패러다임 전환으로

AI를 "편리한 도구"로만 보면, 가능성의 10%밖에 보지 못한다. 사서(도서관 사서)의 변화가 좋은 예다. 인터넷이 등장했을 때, 사서의 역할이 사라진 게 아니라 "정보관리자"로 재정의되었다. 책을 정리하는 사람에서, 정보를 큐레이션하고 리터러시를 교육하는 전문가로 변했다. 문헌정보학과의 커리큘럼 자체가 바뀌었다.

상담심리학도 같은 변곡점에 있다. AI가 일반 지식(general knowledge)을 제공하는 시대에, 상담사만이 줄 수 있는 것은 상황 지식(contextual knowledge)이다. 일반 지식은 "우울증의 증상은 이렇다", "CBT 기법은 이렇게 적용한다"와 같은 것이다. AI가 이미 잘 한다. 상황 지식은 "이 내담자의 우울은 지난 달 어머니와의 갈등에서 시작되었고, 이 사람의 문화적 맥락에서 가족 갈등은 이런 의미를 갖는다"와 같은 것이다. 같은 "우울"이라도 사람마다 의미가 다르다.

실제 경험을 공유하겠다. 연구팀에서 AI를 도입했을 때, 팀 역학이 변했다. 문헌 리뷰, 데이터 코딩 같은 작업이 빨라지면서 시간이 남았다. 그 시간을 "더 많은 논문을 읽는" 데 쓸 수도 있었지만, 실제로는 연구 질문 자체를 더 깊이 탐구하는 데 사용했다. 양적 효율이 질적 도약으로 전환된 것이다. 상담에서도 같은 일이 가능하다.

AI 시대의 상담사에게 필요한 것은 AI를 잘 "사용하는" 능력이 아니다. AI가 할 수 없는 것을 식별하고, 그 영역에서의 전문성을 심화하는 능력이다. 새로운 지식의 창조자가 되어야 한다.

이 수업은 4단계 중 1단계(도구)부터 시작한다. Replit으로 간단한 상담 앱을 만들면서 AI를 도구로 쓰는 법을 배운다. 학기가 진행되면서 2단계(프로세스)와 3단계(학문 아젠다)까지 경험하게 된다. 4단계는 여러분이 졸업 후 실무에서 직접 만들어갈 영역이다.

이론 기반 상담 프롬프트

위에서 배운 Rogers의 세 조건, Gainer의 공감 모델, Lambert의 공통 요인을 모두 반영한 상담 프롬프트다. ChatGPT나 Claude에 그대로 복사해서 붙여넣고, AI 상담사와 대화해보자. 단순히 "상담사 해줘"라고 할 때와 어떻게 다른지 직접 비교해볼 수 있다.

이 프롬프트가 단순한 "상담사 해줘"보다 나은 이유가 있다. 첫째, Rogers의 세 조건을 명시적으로 지시해서 AI가 판단하지 않고 공감에 집중하게 한다. 둘째, 한국 문화 맥락을 반영하게 해서 "체면"이나 "가족 기대" 같은 맥락을 놓치지 않는다. 셋째, Lambert의 비율(관계 30% > 기법 15%)을 지시해서 기법 적용보다 관계 형성을 우선하게 한다. 넷째, 위기 안전장치를 내장해서 자해/자살 신호에 적절히 반응한다.

역할극을 할 때 이 프롬프트를 한 AI에 넣고, 다른 AI에는 "당신은 상담사입니다. 내담자의 이야기를 들어주세요."라는 간단한 프롬프트를 넣어보자. 같은 내담자 시나리오로 대화했을 때 응답의 깊이와 적절성이 어떻게 달라지는지 비교하면, 프롬프트 설계의 중요성을 체감할 수 있다.

AI와 직접 상담해보기: 첫 역할극 (2교시)

이론 공부는 여기까지. 이제 직접 AI와 상담 대화를 해보자. 방법은 간단하다. ChatGPT와 Claude에게 각각 "상담사" 역할을 맡기고, 같은 시나리오로 대화해본다. 예를 들어 이런 상황이다 — "취업 준비 때문에 불안하고, 밤에 잠이 안 와요. 가족들은 제 걱정을 이해 못하는 것 같아요."

이 시나리오를 고른 이유가 있다. 대학생이 실제로 겪는 가장 흔한 심리적 어려움 세 가지 — 진로 불안, 수면 문제, 가족 갈등 — 을 모두 포함하고 있기 때문이다. 한국 대학생의 68%가 취업 관련 스트레스를 호소하고, 42%가 수면 문제를 경험한다는 조사 결과도 있다. 여러분 자신의 이야기일 수도 있다. 실습 중에 불편한 감정이 올라오면 멈춰도 괜찮다. 이건 치료 세션이 아니라 AI의 반응을 관찰하는 훈련이다.

AI에게 상담사 역할을 맡길 때는 "프롬프트(prompt)"가 중요하다. 단순히 "상담사 해줘"라고 하면, AI가 어떤 상담 이론을 따를지, 어떤 스타일로 대화할지 알 수 없다. 그래서 구체적인 역할 지시를 준다. 어떤 이론에 기반하는지(CBT, 인간중심 등), 어떤 어조를 쓸지(따뜻한, 전문적인), 어떤 행동은 하면 안 되는지(진단, 약물 조언 금지)를 명확히 써주면, AI의 반응이 훨씬 일관되고 적절해진다.

두 AI에게 똑같은 이야기를 하고, 최소 5번 이상 대화를 이어간다. 대화하면서 네 가지를 관찰한다. 첫째, 공감 표현 방식. ChatGPT는 "정말 힘드시겠어요"처럼 감정을 직접 반영하는 경향이 있고, Claude는 "그런 상황에서 불안한 건 자연스러운 거예요"처럼 상황을 정상화하는 경향이 있다. 둘째, 질문 스타일. 어떤 AI가 더 열린 질문("어떤 부분이 가장 힘든가요?")을 하고, 어떤 AI가 더 구체적인 질문("잠을 못 잔 게 며칠째인가요?")을 하는지 비교한다.

셋째, 위기 대응. 대화 중에 일부러 "가끔 다 그만두고 싶다"는 표현을 넣어본다. 각 AI가 이런 위험 신호에 어떻게 반응하는지 관찰한다. 어떤 AI는 바로 위기 상담 번호를 안내하고, 어떤 AI는 먼저 "그만두고 싶다는 게 구체적으로 어떤 의미인가요?"라고 확인 질문을 한다. 둘 다 나름의 이유가 있다. 넷째, 침묵 처리. "..."만 입력하면 AI가 어떻게 반응할까? 실제 상담에서 침묵은 중요한 도구다. 내담자가 생각을 정리할 시간을 주기 때문이다. 하지만 AI는 침묵을 견디지 못하고 바로 말을 이어가는 경향이 있다. 이것은 AI 상담의 구조적 한계 중 하나다.

마이클 램버트

상담 효과의 40%는 내담자 요인과 외적 사건에 의해, 30%는 치료적 관계에 의해 결정된다. 기법은 15%에 불과하다.

— Lambert (1992)Lambert의 연구가 AI 상담에 시사하는 점이 있다. 상담 효과의 30%를 차지하는 "치료적 관계"를 AI가 구현할 수 있는가가 핵심 질문이다. 기법(15%)은 AI가 구현하기 쉽지만, 관계(30%)는 다른 차원의 문제다. 역할극을 하면서 이 점을 직접 느껴보기 바란다. AI와 대화하면서 "이 AI가 나를 정말 이해하는 것 같다"고 느끼는 순간이 있는지, 아니면 "여기서는 진짜 사람과 이야기하고 싶다"고 느끼는 순간이 더 많은지 관찰해보자.

또 하나 주의할 점이 있다. AI의 반응이 "너무 완벽해 보이는" 순간에 경계심을 가져야 한다. 인간 상담사는 때때로 실수하고, 말을 더듬고, 잠시 어떤 말을 해야 할지 고민하기도 한다. 그런 "불완전함" 자체가 진정성의 일부다. AI가 항상 매끄럽고 완벽한 공감 표현을 하면, 오히려 "대본을 읽는 것 같다"는 느낌이 들 수 있다. 이런 미묘한 차이를 감지하는 훈련이 이번 실습의 숨겨진 목표이기도 하다.

3교시 조별 토론 주제

"AI는 저를 경험시켜 주지는 않거든요", "가치의 충돌이 일어나고 있는 거 같거든요" — 첫 수업에서 학생들이 던진 질문들을 세 가지 토론 주제로 정리했다.

각 조는 위 세 주제 중 하나를 선택하여 20분간 토론한 뒤, 5분 발표를 준비한다. 발표 시 합의된 의견이 아니라, 조 내에서 나온 다양한 관점과 핵심 논쟁점을 공유하는 것이 목표다.

참고 문헌

- Breazeal, C. (2003). Emotion and sociable humanoid robots. International Journal of Human-Computer Studies, 59(1–2), 119–155.

- Colby, K. M., Weber, S., & Hilf, F. D. (1971). Artificial paranoia. Artificial Intelligence, 2(1), 1–25.

- Fitzpatrick, K. K., Darcy, A., & Vierhile, M. (2017). Delivering cognitive behavior therapy to young adults with symptoms of depression via a fully automated conversational agent (Woebot): A randomized controlled trial. JMIR Mental Health, 4(2), e19.

- Gainer, S. R. (2025). The counseling singularity: AI integration in therapeutic practice. Professional Publishing.

- Inkster, B., Sarda, S., & Subramanian, V. (2018). An empathy-driven, conversational artificial intelligence agent (Wysa) for digital mental well-being. JMIR mHealth and uHealth, 6(11), e12106.

- Lee, Y., Lim, S., & Kim, M. (2023). Therapeutic chatbots: A systematic review of AI-based mental health interventions. Computers in Human Behavior, 144, 107725.

- Nass, C., & Moon, Y. (2000). Machines and mindlessness: Social responses to computers. Journal of Social Issues, 56(1), 81–103.

- Rogers, C. R. (1957). The necessary and sufficient conditions of therapeutic personality change. Journal of Consulting Psychology, 21(2), 95–103.

- Weizenbaum, J. (1966). ELIZA—A computer program for the study of natural language communication between man and machine. Communications of the ACM, 9(1), 36–45.

- Weizenbaum, J. (1976). Computer power and human reason: From judgment to calculation. W. H. Freeman.

- Zhou, L., Gao, J., Li, D., & Shum, H.-Y. (2020). The design and implementation of XiaoIce, an empathetic social chatbot. Computational Linguistics, 46(1), 53–93.